LazyCraft 是基于 LazyLLM 搭建的应用编排平台,它支持大模型调用和自定义代码块,具备强大的资源管理和数据集成能力,并配合 RAG 技术,支持自定义离线解算和在线调用。在 LazyCraft 中使用 SiliconFlow 模型,结合 SiliconFlow 模型丰富、速度快的优势,快速构建多样化的 AI 应用。Documentation Index

Fetch the complete documentation index at: https://docs.siliconflow.cn/llms.txt

Use this file to discover all available pages before exploring further.

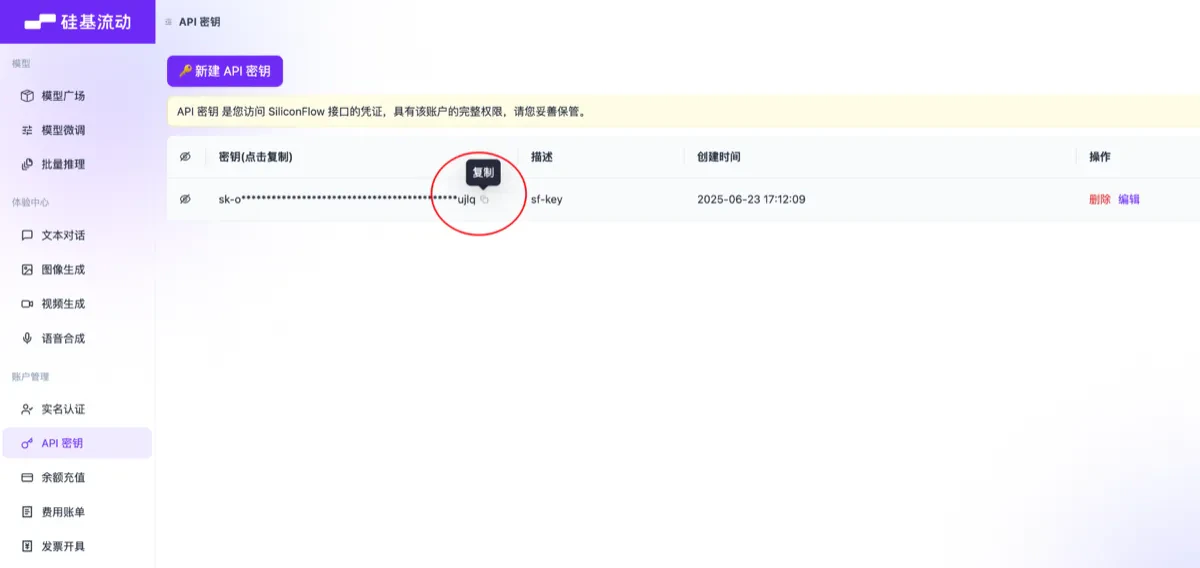

1. 获取 SiliconFlow API Key

- 注册硅基流动账号。点击注册

- 进入控制台,获取 API key。

- 点击密钥进行复制,用于在 LazyCraft 中使用。

💡 提示:API Key 是访问 SiliconFlow 服务的凭证,请妥善保管,不要泄露给他人。

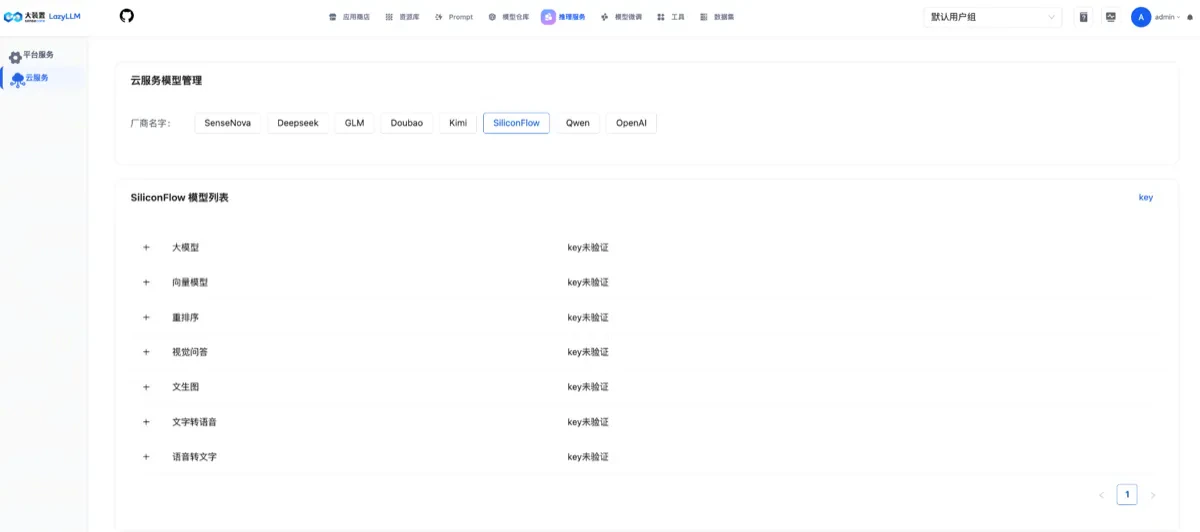

2. 在 LazyCraft 中配置 SiliconFlow

2.1 配置 API Key

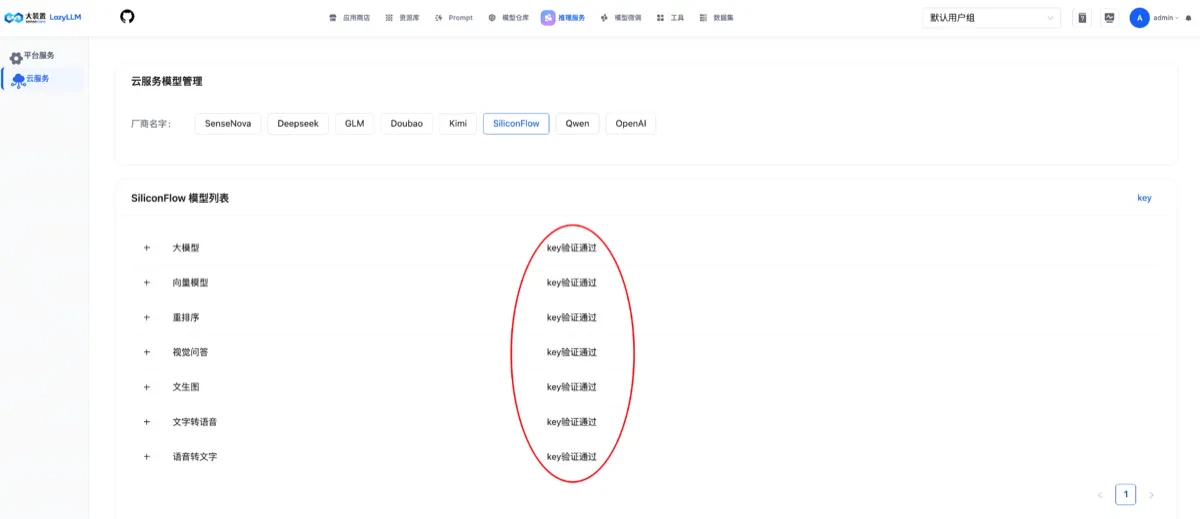

通过模型管理页面配置- 进入云服务页面

- 登录 LazyCraft 平台后,点击顶部导航栏的 “推理服务” 菜单

- 进入左侧 “云服务” 页面

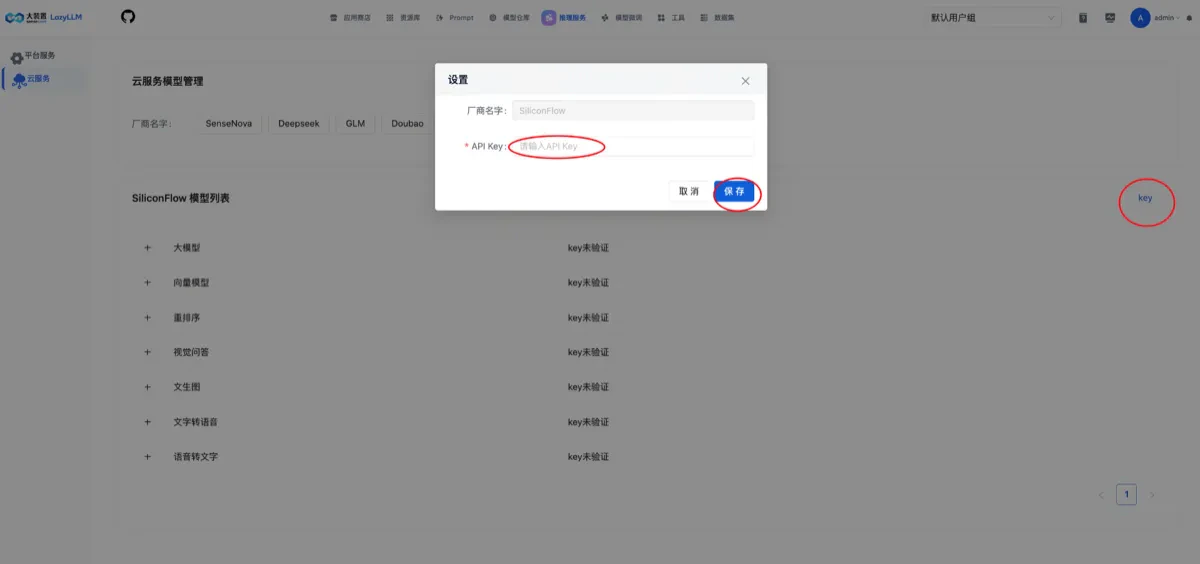

- 配置 API Key

- 从厂家名字中选择 “SiliconFlow” 云模型

- 在页面SiliconFlow模型列表行最右侧找到 “key” 按钮

- 点击进入配置页面

- 将之前复制的 API Key 粘贴到输入框中

- 点击 “保存” 按钮

- 验证配置

- 配置成功后,系统会自动验证 API Key 的有效性

- 验证通过后,即可在应用中使用 SiliconFlow 的模型

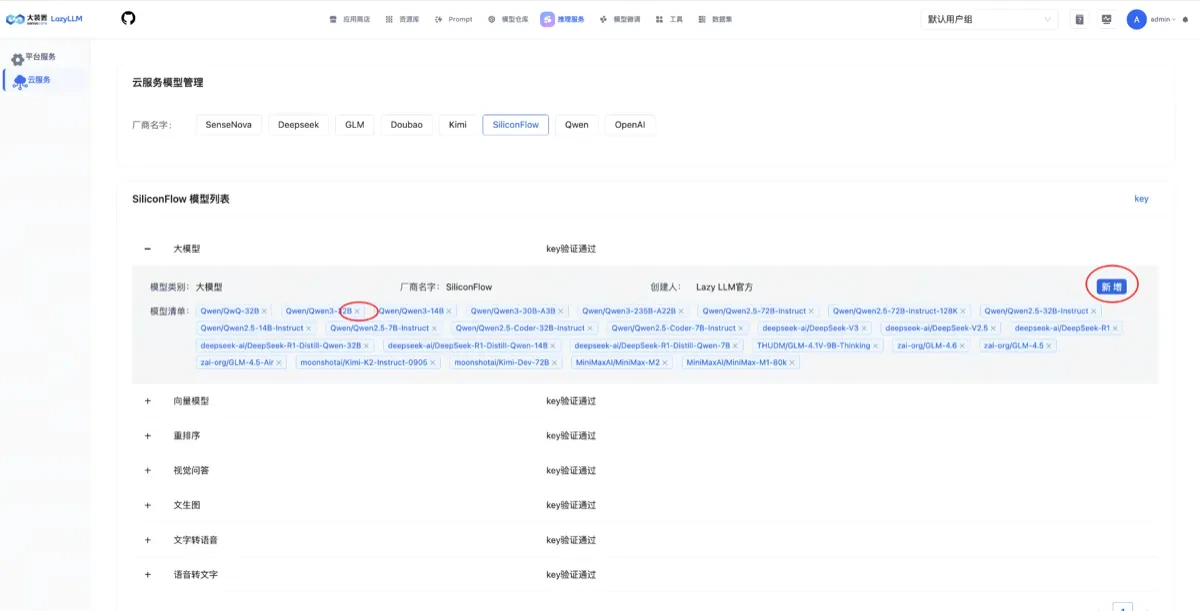

2.2 管理模型清单

LazyCraft 内置了 SiliconFlow 的模型清单,支持以下模型类型:支持的模型类型

| 模型类型 | 说明 | 代表模型 |

|---|---|---|

| LLM | 大语言模型 | Qwen/Qwen3-32B, DeepSeek-V3, GLM-4.6 等 |

| Embedding | 向量模型 | BAAI/bge-m3, Qwen/Qwen3-Embedding-8B 等 |

| Reranker | 重排序模型 | BAAI/bge-reranker-v2-m3, Qwen/Qwen3-Reranker-8B 等 |

| VQA | 视觉问答 | Qwen/Qwen3-VL-32B-Instruct, deepseek-ai/deepseek-vl2 等 |

| SD | 文生图 | Qwen/Qwen-Image, Kwai-Kolors/Kolors 等 |

| TTS | 文字转语音 | fnlp/MOSS-TTSD-v0.5, FunAudioLLM/CosyVoice2-0.5B 等 |

| STT | 语音转文字 | FunAudioLLM/SenseVoiceSmall, TeleAI/TeleSpeechASR 等 |

修改模型清单

通过云服务页面修改模型清单- 进入 “推理服务” → “云模型”

- 厂商名字选择 “SiliconFlow”

- 即可看到所有可用的 SiliconFlow 模型类型及每个模型类型中的模型清单

- 可根据实际需要对模型清单进行新增或者删除

- 填写模型名称(需与 SiliconFlow 平台上的模型名称一致)SiliconFlow模型列表

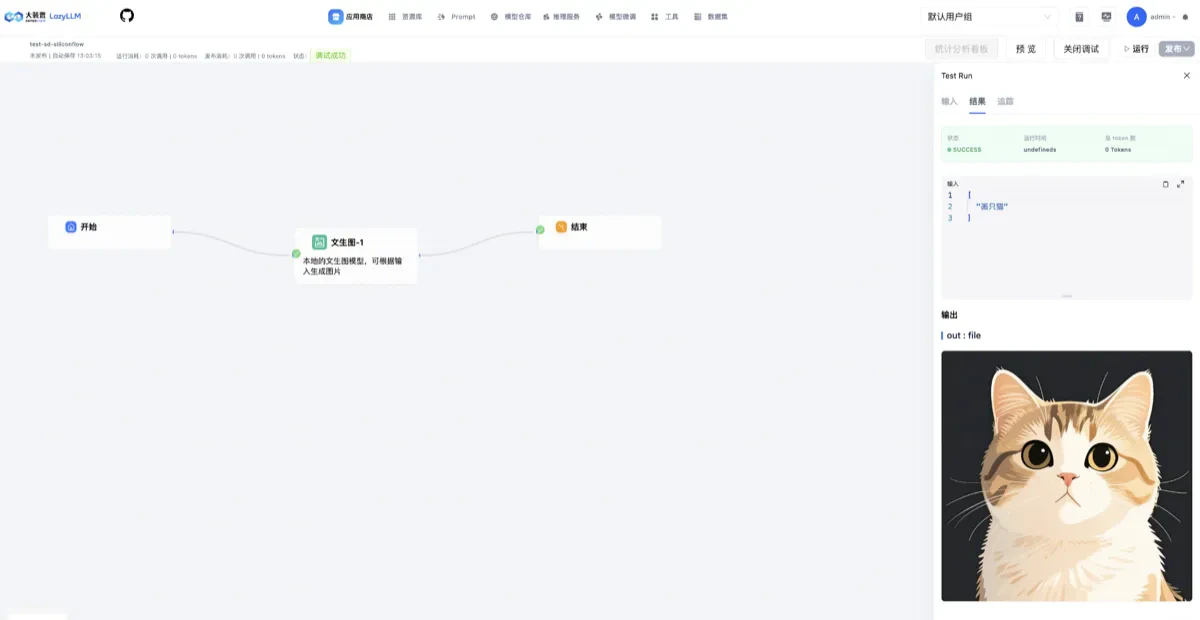

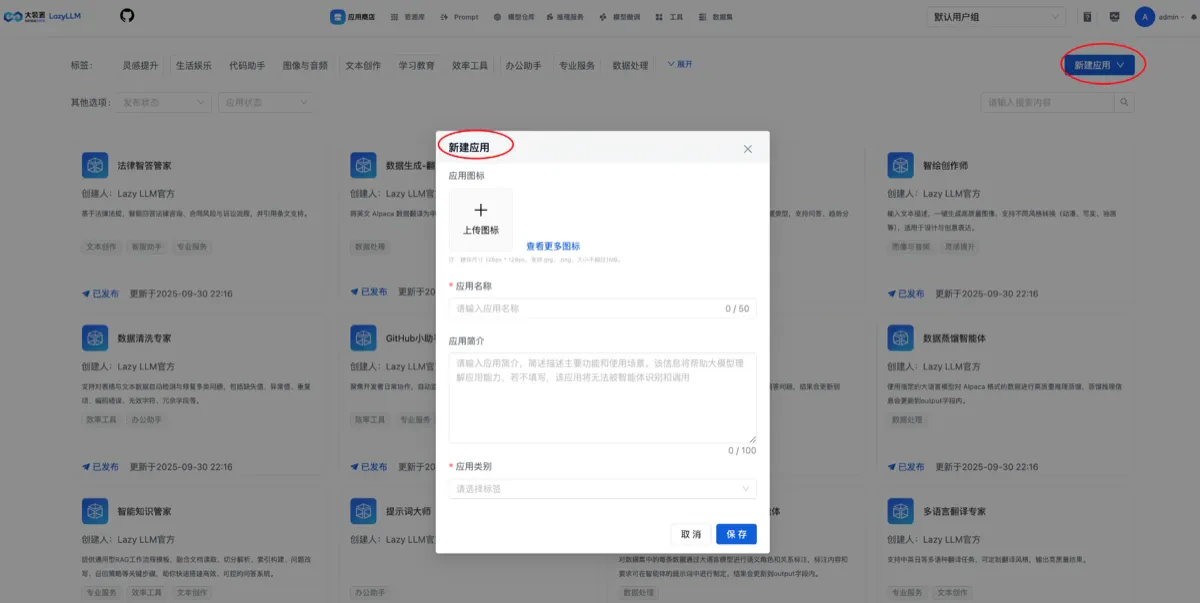

3. 在画布中创建应用

LazyCraft 提供了强大的可视化画布功能。下面将展示如何使用 SiliconFlow 的不同类型模型创建应用。3.1 大语言模型(LLM)应用示例

场景:智能对话助手

使用模型:Qwen/Qwen3-32B 或 deepseek-ai/DeepSeek-V3

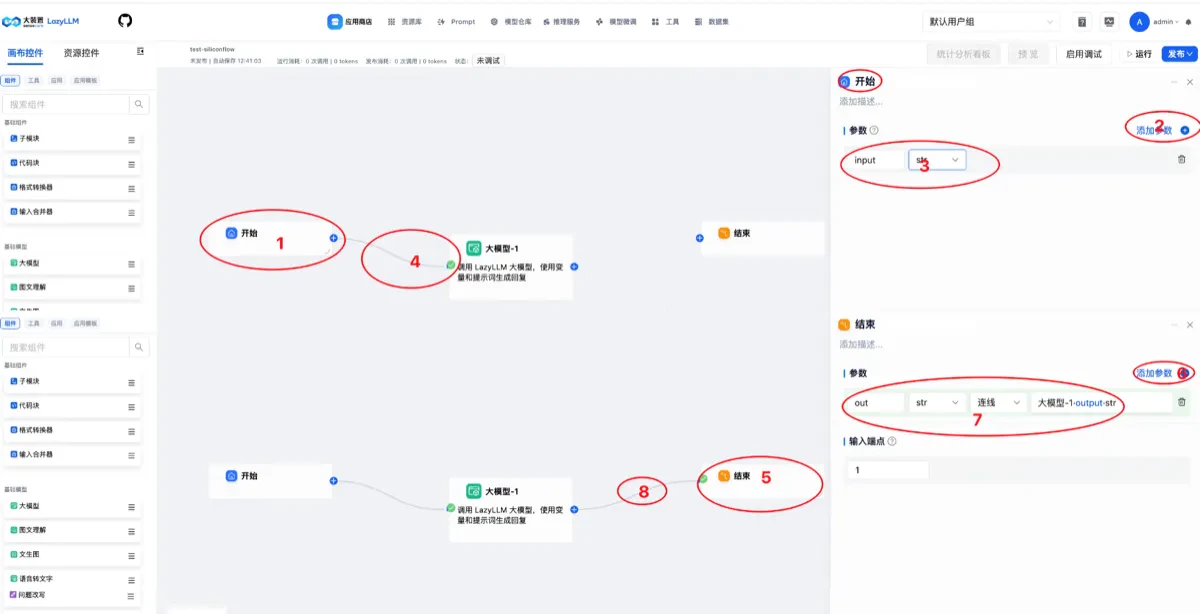

创建步骤:

- 创建新应用

- 点击 “应用商店” → “新建应用”

- 选择 “创建空白应用”

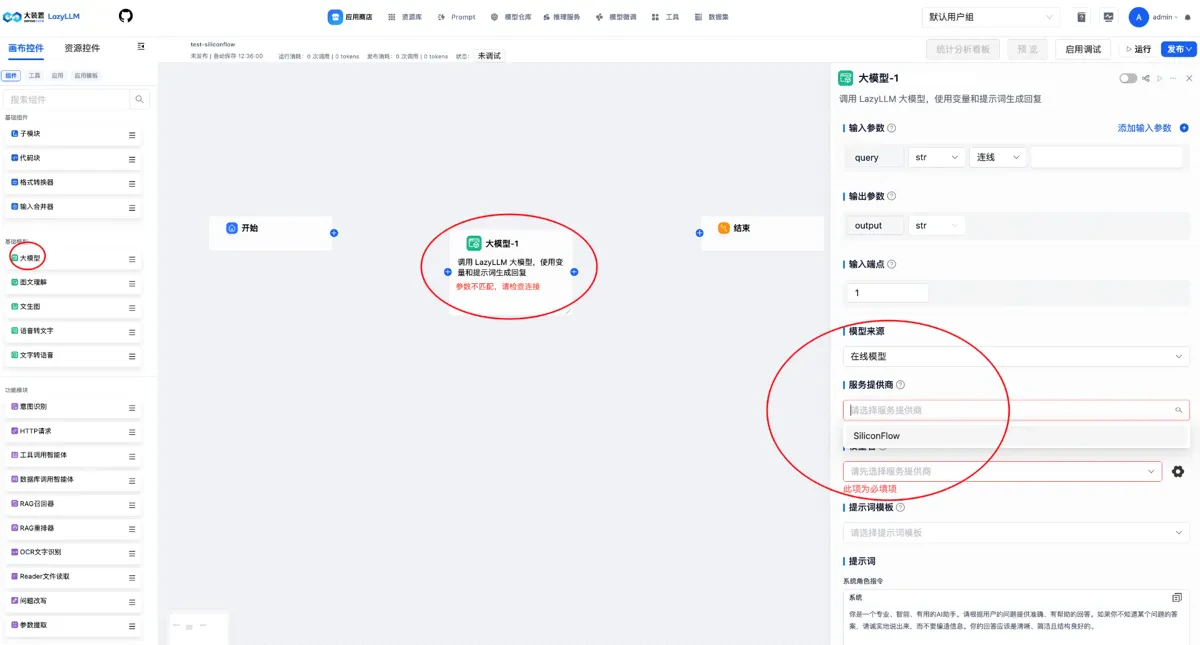

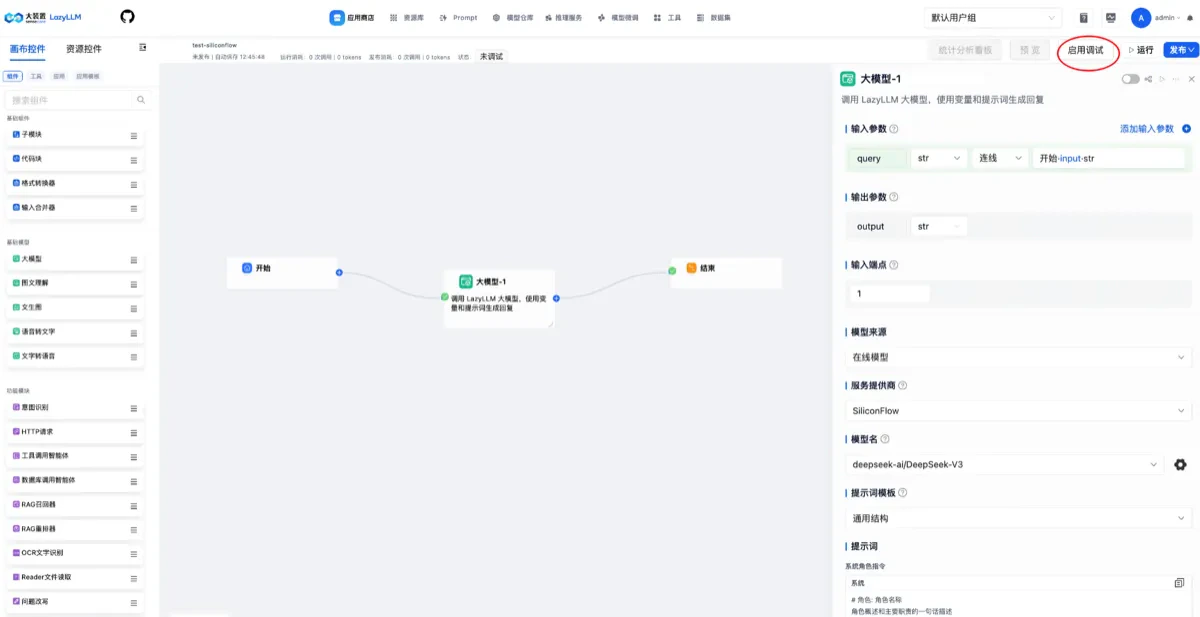

- 添加 LLM 节点

- 在画布中拖入 “大模型” 节点

- 点击节点进行配置:

- 模型来源:选择

在线模型 - 服务提供商:选择

SiliconFlow - 模型名:选择

Qwen/Qwen3-32B或DeepSeek-V3 - 其它如提示词模板等参数可以根据需要进行选择也可以直接使用默认值

- 模型来源:选择

- 连接节点

- 点击 “开始” 节点添加输入参数,并将 “开始” 节点连接到 “大模型-1” 节点

- 点击 “结束” 节点添加输出参数,并将 “大模型-1” 节点连接到 “结束” 节点

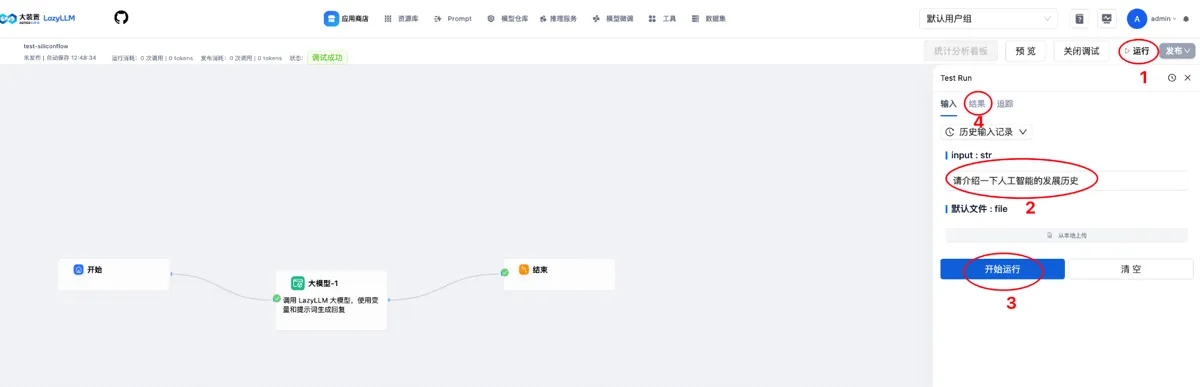

- 测试运行

- 点击右上角 “启用调试” 按钮

- 点击 “运行” 按钮,输入测试问题,如:“请介绍一下人工智能的发展历史”

- 查看模型返回的结果

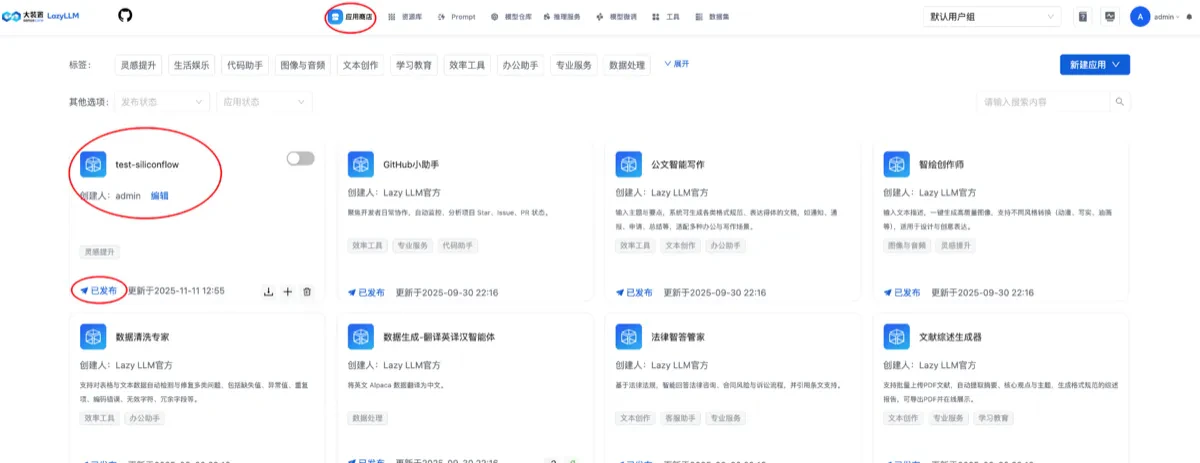

- 应用发布

- 点击右上角 “发布” 按钮

- 在弹出框内确认发布版本号后,点击 “确认” 按钮,即发布成功

- 可在 “应用商店” 查看已发布应用

- 可随时启动/关闭服务,对外提供服务能力(服务页面、API发布)

3.2 其它模型应用示例

场景:其它类型的模型可参考大模型节点配置方法进行自行配置体验

比如文生图使用效果如下: