📋 核心参数速查

- Provider (提供商):

siliconflow - API Key (密钥): 前往 SiliconCloud 控制台获取

- 推荐模型 ID:

- 对话 (Chat):

deepseek-ai/DeepSeek-V3(推荐) 或deepseek-ai/DeepSeek-R1 - 补全 (Autocomplete):

Qwen/Qwen2.5-Coder-7B-Instruct(速度快、延迟低)

- 对话 (Chat):

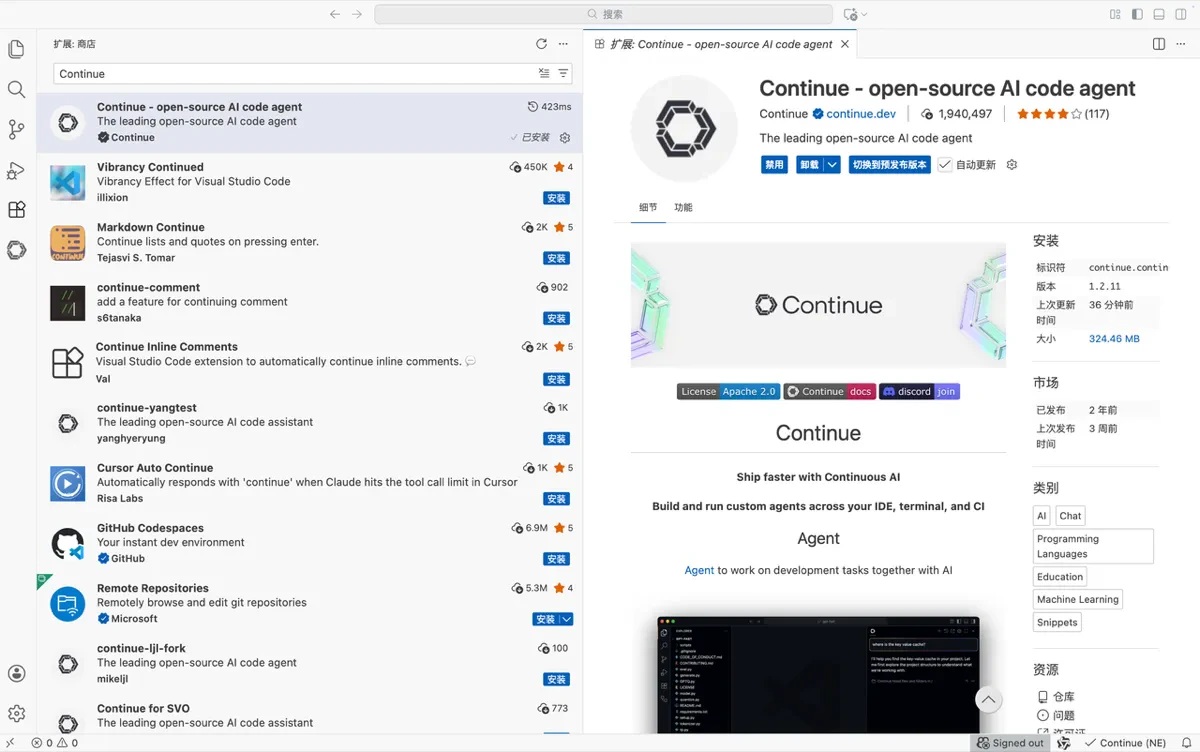

插件安装

VS Code 的插件市场搜索 Continue,安装并启用。

配置步骤

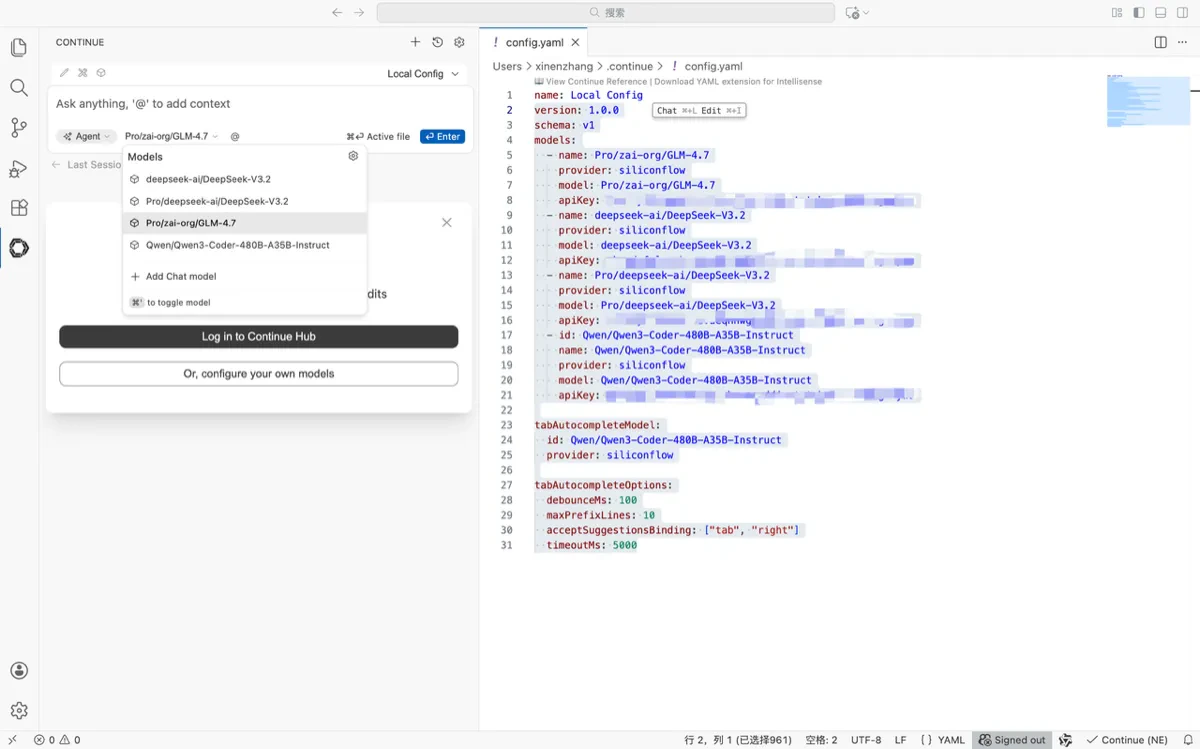

Continue 的所有模型配置均通过config.yaml 文件管理。

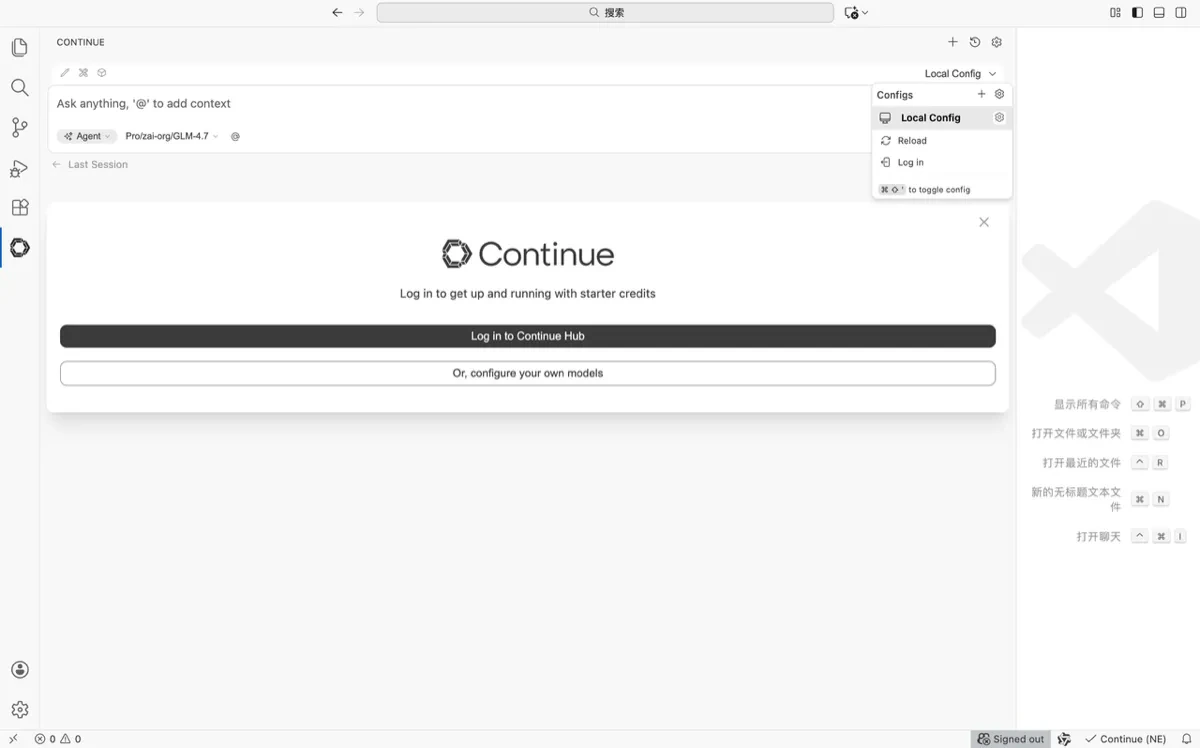

第一步:打开配置文件

您可以通过下面方式打开配置文件: 界面:点击 Continue 插件面板右上角的 “齿轮” (Settings) 图标,点击左侧边栏的 “文件”(Configs) 图标,点击 Local Config 右侧 “齿轮” (Settings) 图标,打开配置文件 config.yaml。

第二步:修改 config.json

请将以下两部分配置分别整合到您的 config.json 文件中。

1. 配置对话模型 (Chat Models)

在models 列表中添加硅基流动的模型配置,允许配置多个模型和api key,下面是一个实例,配置了 Pro/zai-org/GLM-4.7、deepseek-ai/DeepSeek-V3.2、Pro/deepseek-ai/DeepSeek-V3.2三个模型。

2. 配置自动补全模型 (Tab Autocomplete)

为了实现类似 GitHub Copilot 的“按 Tab 键补全”功能,建议使用响应速度更快的 Qwen/Qwen3-Coder-480B-A35B-Instruct 模型。请在配置文件的根层级(与models 平级)添加 tabAutocompleteModel 字段。

完整配置示例

如果您希望直接覆盖原文件,可以使用以下完整的config.yaml 模板。

注意:请务必将 sk-xxxxxxxx... 替换为您真实的 API Key。

-

保存文件: 修改完成后保存

config.yaml,Continue 通常会自动重载配置(如果没有生效,请尝试重启 IDE)。 -

测试对话:

- 在 Continue 对话框中 model 中有配置文件中的所有文件,可以选择任意配置的模型。

- 发送测试消息(如 “Hello”),确认能否收到回复。

-

测试补全:

- 打开任意代码文件(例如 Python 文件)。

- 输入代码片段(如

def quick_sort(arr):)并稍作停顿。 - 如果光标后出现灰色的建议代码,说明自动补全配置成功。